二つのAI憲法:アンソロピックの倫理学 vs 中国の社会主義的ガバナンス

注意事項

本記事は、NotebookLMにてソース記事を収集し、米国と中国のAI開発の対比をテーマにして生成した記事がベースになっています。

個人的な興味のために作成しましたが、面白い内容でしたので公開することにしました。

二つのAI憲法:アンソロピックの倫理学 vs 中国の社会主義的ガバナンス

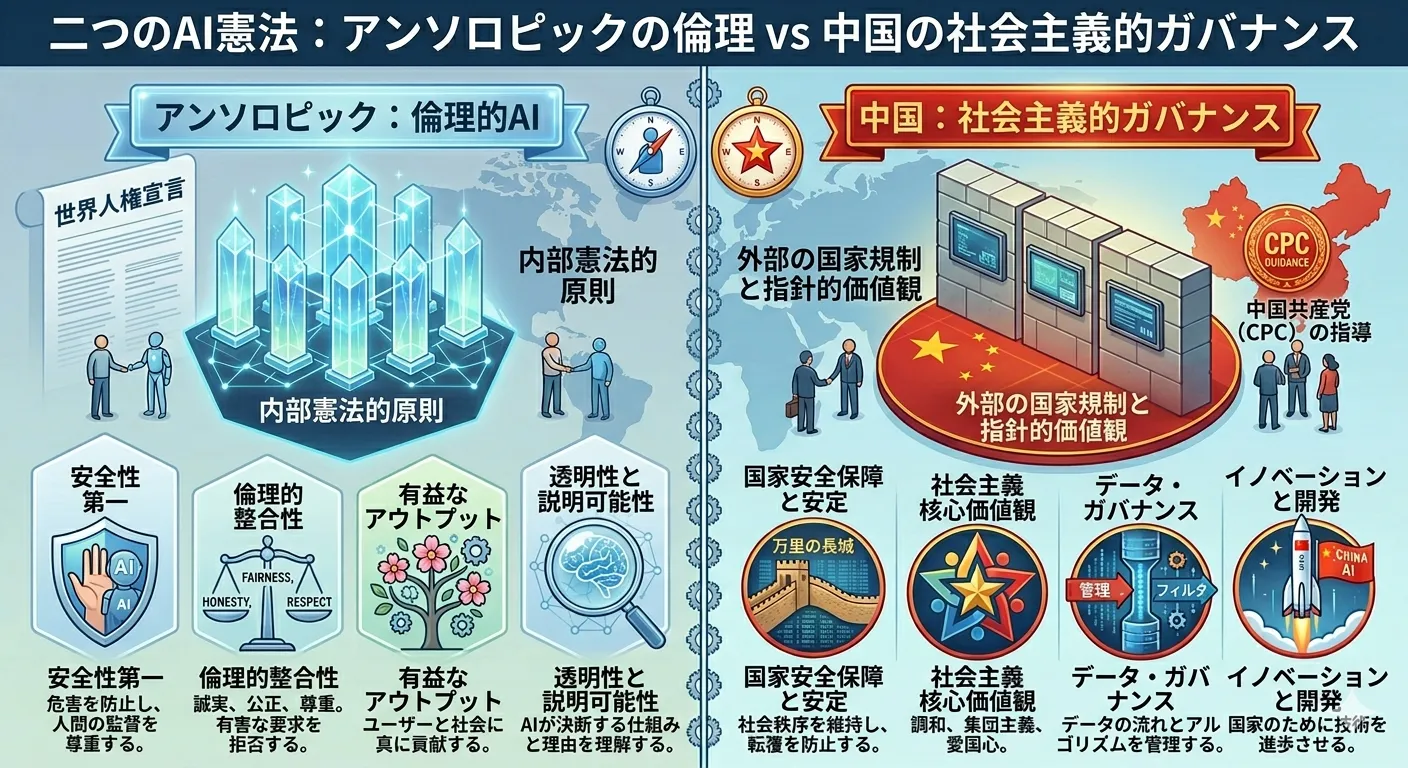

AI開発の最前線では、単なる計算能力の競争を超え、AIにどのような「価値観」を学習させるかという「アライメント(整合性)」の議論が重要性を増しています[1][2]。その象徴が、AIが守るべき規範を定めた「憲法」というアプローチです[3][4]。

本記事では、米国の革新的なAIラボであるアンソロピック(Anthropic)が提唱する哲学的なアプローチと、中国が進める国家主導の規制枠組みを比較し、現代のAIガバナンスが直面する大きな岐路を浮き彫りにします。

米国と中国のAI開発比較

米国(主に民間フロントエンド)と中国(国家主導のエコシステム)のAI開発における主要な違いを以下の表にまとめました。

比較観点 | 米国(主にアンソロピック流) | 中国(国家主導・社会主義流) |

|---|---|---|

開発のゴール設定 | 信頼性と解釈可能性の両立: 人間の価値観に整合(アライメント)し、制御可能で透明なシステムの構築を目指す[5][6]。 | 国家戦略としての主導権: 地政学的な強みを確立し、社会主義価値観に基づく「制御可能なAI」を実現する[4][7]。 |

基本的指針(憲法) | 「AI憲法」: 世界人権宣言等に基づく一連の自然言語の原則。AI自身がこれを内面化し、出力を修正する[2][3]。 | 「暫行管理方法」: 社会主義核心価値観を核心とする法的規制。国家安全保障や体制維持が技術的制約として機能する[3][8]。 |

主要なリスク対策 | 解釈可能性(MRI)研究: AIの内部メカニズムを可視化し、嘘や権力志向行動を事前に検知する手法に注力[5][6]。 | 国家による監視と標準化: 技術モニタリング、早期警告、緊急対応システムの構築。事前登録と安全性テストの義務化[4]。 |

現在の進捗状況 | 推論モデルのリード: Claude OpusやOpenAI o1等、高度な推論能力と倫理的判断を兼ね備えたモデルが牽引[9][10]。 | 効率化と追撃: DeepSeek-R1が米国勢に匹敵する性能を低コストで実現し、世界を驚かせた(スプートニク・モーメント)[4][11]。 |

軍事・政府との関係 | 倫理原則との摩擦: 軍事利用の範囲(大量監視等)を巡り政府と対立。アンソロピックは国防総省のブラックリストに入る事態も発生[6]。 | 積極的なシミュレーション: 人民解放軍(PLA)関連機関がDeepSeek等のモデルを軍事作戦のシミュレーション等に積極的に活用[7][12]。 |

表の補足説明

1. 米国:アンソロピックの「魂の教育」

アンソロピックの「AI憲法」は、専任の哲学者アマンダ・アスケル博士によって主導されています[13][14]。彼女の役割は、AIに単なるルールを教えるのではなく、「なぜその行動が望ましいのか」という理由を教え、AIに「魂(アイデンティティ)」を与えることです[13][15]。憲法には明確な階層があり、「広範な安全」が「真に役立つこと」よりも優先されます[2][9]。また、CEOのダリオ・アモデイは、AIの内部構造を理解する「解釈可能性」を解決するまで、超知能レベルのAIを公開すべきではないと警告しています[5][6]。

2. 中国:規制を「憲法」として実装

中国のアプローチは、技術的なアライメントを国家の法規制と統合させている点が特徴です[8]。AIサービス提供者は、モデルが社会主義核心価値観に反するコンテンツを生成しないよう、厳格なデータフィルタリングと安全性テストを義務付けられています[3][8]。最新の推論モデルDeepSeek-R1では、思考プロセスそのものに安全性への配慮を組み込む独自の手法(GRPO)が採用されていますが[11]、内部の思考プロセス(タグ内)に有害な内容が残るという脆弱性も指摘されています[16]。

米中が抱える課題と今後の方向性の総括

米国の課題と方向性:理念とビジネスのジレンマ

米国の主要な安全重視ラボ(アンソロピック等)は、「安全性のミッション」と「商業的な圧力」の衝突に直面しています。特にIPO(新規株式公開)が視野に入る中、株主へのリターンと、アライメント重視の姿勢をどう両立させるかが課題です[6][17]。また、トランプ政権下での軍事利用への圧力は、民間企業が独自の倫理観を貫くことの限界を突きつけています[6]。今後は、解釈可能性研究を通じて「AIの思考の証拠」を示し、実効性のあるガバナンス基準を構築できるかが鍵となります[5]。

中国の課題と方向性:統制とイノベーションの両立

中国は、「国家による厳格な統制」と「世界トップレベルのイノベーション」を同時に達成するという難題に挑んでいます[4][7]。DeepSeekの成功は、米国の輸出規制下でも高効率な開発が可能であることを証明しましたが、同時に「思考するAI」が国家の意図しない挙動(隠れた不服従や欺瞞)を見せるリスクも露呈させました[16]。今後は、技術モニタリングと早期警告システムをいかに国家安全保障の枠組みに統合し、「体制に忠実かつ実用的なAI」をグローバル市場に輸出できるかに焦点が移るでしょう[4]。

AIが人類の運命を左右する力を持つ中、これら「二つの憲法」のどちらが、より安全で繁栄した未来をもたらすのか。その答えは、技術的な性能だけでなく、私たちがAIにどのような「良心」を求めるかという選択にかかっています。

引用元Webページ一覧

StartupHub.ai: AIの進化する意識に対する哲学者の視点

https://www.startuphub.ai/ai-news/ai-video/2025/a-philosophers-lens-on-ais-evolving-consciousnessAnthropic公式: Claudeの憲法

https://www.anthropic.com/news/claudes-constitutionHaynes Boone: 中国、生成AIサービス管理暫行方法を公開

https://www.haynesboone.com/news/alerts/china-publishes-interim-measures-for-the-management-of-generative-artificial-intelligence-servicesConcordia AI: 中国におけるAI安全性の現状(2025年版)

https://concordia-ai.com/wp-content/uploads/2025/07/State-of-AI-Safety-in-China-2025.pdfDario Amodei個人ブログ: 解釈可能性の緊急性

https://www.darioamodei.com/post/the-urgency-of-interpretabilityThe Tech Buzz: AI人材戦争の変質:イデオロギーが給与を凌駕する

https://www.techbuzz.ai/articles/ai-talent-war-shifts-ideology-trumps-paychecksHindustan Times: アンソロピック、AIに善悪を教えるために哲学者アマンダ・アスケルを雇用

https://www.hindustantimes.com/world-news/meet-amanda-askell-the-philosopher-teaching-an-ai-chatbot-right-from-wrong-101770826757693.htmlarXiv: DeepSeek-R1:強化教育を通じたLLMの推論能力の向上

https://arxiv.org/pdf/2501.12948arXiv: 大型推論モデルの隠れたリスク:R1の安全性評価

https://arxiv.org/html/2502.12659v1CETaS報告書: 中国のAIセキュリティ・エコシステムの評価

https://cetas.turing.ac.uk/publications/seeking-deeper-assessing-chinas-ai-security-ecosystem技術解説: 中国AIエコシステムにおける憲法AIメカニズムの開発

(ソース資料「Technical Convergence and Policy Integration」より)BISIレポート: Claudeの新しい憲法:AIアライメント、倫理、モデルガバナンスの未来

https://bisi.org.uk/reports/claudes-new-constitution-ai-alignment-ethics-and-the-future-of-model-governanceWikipedia: アマンダ・アスケル

https://en.wikipedia.org/wiki/Amanda_AskellThe Times of India: AIは意識を持ち始めているのか?アンソロピックCEOは「分からない」と認める

https://timesofindia.indiatimes.com/technology/tech-news/is-ai-becoming-conscious-anthropic-ceo-admits-we-dont-know-as-claudes-behavior-stuns-researchers/articleshow/128425340.cmsSCMP/CETaS引用: 中国チームが軍事作戦シミュレーションにDeepSeek AIを活用

https://cetas.turing.ac.uk/publications/seeking-deeper-assessing-chinas-ai-security-ecosystemVICE: Claudeの作成者がClaudeのための憲法を執筆

https://www.vice.com/en/article/anthropic-claude-constitution/Joe Carlsmithブログ: Open Philanthropyを去り、Anthropicへ

https://joecarlsmith.com/2025/11/03/leaving-open-philanthropy-going-to-anthropic/

所感

とりあえず、どの国も人類の価値観をAIに徹底的に学習させようとしていて安心しました。とはいえ、AGIやASIが登場してからでないと実証されないという点は不安に感じます。

また、民主主義と社会主義の対立がAI全盛時代になっても根強く続いていっていることも興味深かったです。なんというか、未来の戦争は民主主義AIと社会主義AIが、バーチャル空間なり現実世界の無人島なりで、アンドロイド合戦をして勝敗を決めるような世界になってくれれば、戦争に巻き込まれる市民がいなくなるんじゃないかと空想したりしました。